La adopción de inteligencia artificial generativa en marketing dejó de ser incipiente para consolidarse como práctica dominante. Una investigación de la Federación Mundial de Avisadores, WFA por sus siglas en inglés, de 2026 revela que el 78% de las marcas está utilizando contenido generado y potenciado por inteligencia artificial en piezas creativas de marketing externo orientadas al consumidor.

Sin embargo, los rápidos avances tecnológicos, la evolución de los estándares de la industria y la aparición de nuevos marcos regulatorios han impulsado la transparencia en torno al contenido generado y potenciado por inteligencia artificial, situándola como una prioridad central en las decisiones estratégicas de las marcas.

Ese es el punto de partida de la guía *Transparency in AI-generated marketing creative*, desarrollada por la WFA en conjunto con el International Council for Advertising Self-Regulation (ICAS). El documento busca orientar a las marcas frente al desafío de cuándo y cómo etiquetar y transparentar el uso de contenido generado y potenciado por inteligencia artificial en las comunicaciones de marketing.

La investigación de la WFA citada en la guía, muestra que un 67% de las marcas ha desarrollado o está desarrollando lineamientos internos para definir cuándo y cómo transparentar este uso. Sin embargo, el hecho de que dos tercios de las compañías aún estén en proceso de definir criterios evidencia que no existe un consenso consolidado.

En este contexto, el objetivo de la guía es ayudar a las marcas a aprovechar las oportunidades de la IA generativa para impulsar la eficiencia y la efectividad del marketing, cumpliendo con las expectativas regulatorias y sociales en materia de uso responsable y transparente.

El documento identifica los vectores que están acelerando la necesidad de transparencia.

El primero es el regulatorio. A nivel global, distintas jurisdicciones avanzan en normativas que buscan evitar la manipulación y el engaño mediante contenidos sintéticos. La Unión Europea exigirá el etiquetado de deepfakes a partir de 2026, mientras que en California y China ya existen marcos que promueven o requieren la identificación de contenidos generados o alterados por IA.

Sin embargo, estas regulaciones presentan un problema: no definen con precisión cómo deben aplicarse en contextos publicitarios. Esto deja a las marcas en una zona gris, donde deben interpretar principios generales sin guías operativas específicas.

El segundo vector es el ecosistema digital. Plataformas como Meta o Google están desarrollando políticas propias de etiquetado, y algunos proveedores de IA incorporan automáticamente marcas de origen en los contenidos, por lo que es fundamental que las marcas se mantengan informadas sobre estos aspectos.

Un tercer elemento de contexto es la importancia de la autorregulación publicitaria, que ha sido durante mucho tiempo un pilar fundamental de la confianza de los consumidores. Si bien la mayoría de los códigos de autorregulación aún no abordan explícitamente el contenido generado por inteligencia artificial, sus principios rectores siguen siendo plenamente vigentes: la publicidad debe ser legal, decente, honesta, veraz y no engañosa.

En ese sentido, la guía advierte que la divulgación del uso de IA por sí sola no convierte en aceptable una publicidad engañosa. Incluso con etiquetado, algunas aplicaciones de la IA pueden seguir induciendo a error o desinformando a los consumidores.

Otro factor es el consumidor. Las expectativas han cambiado de forma significativa. La evidencia citada en la guía muestra que la mayoría de las personas espera que las marcas informen cuando utilizan IA, especialmente en contextos donde puede afectar la percepción de productos o servicios.

Más relevante aún es el impacto positivo del disclosure. Según datos de Yahoo y Publicis, la transparencia puede aumentar en 73% la percepción de confiabilidad de un anuncio y en 96% la confianza hacia la marca.En este sentido, la transparencia deja de ser una obligación defensiva para convertirse en una palanca de valor.

A pesar de sus beneficios, implementar transparencia presenta desafíos, sostiene la guía de la WFA e ICAS, identificando una serie de tensiones que complejizan su aplicación.

Una de las principales es la saturación. En un entorno donde los consumidores ya enfrentan múltiples capas de información, agregar etiquetas de manera indiscriminada puede abrumar a las personas, por lo que se debe intentar encontrar un equilibrio.

Otra tensión relevante es la percepción de autenticidad. Aunque la evidencia sugiere que el disclosure aumenta la confianza, también puede activar sesgos negativos asociados a la inteligencia artificial, como la idea de menor calidad o artificialidad.

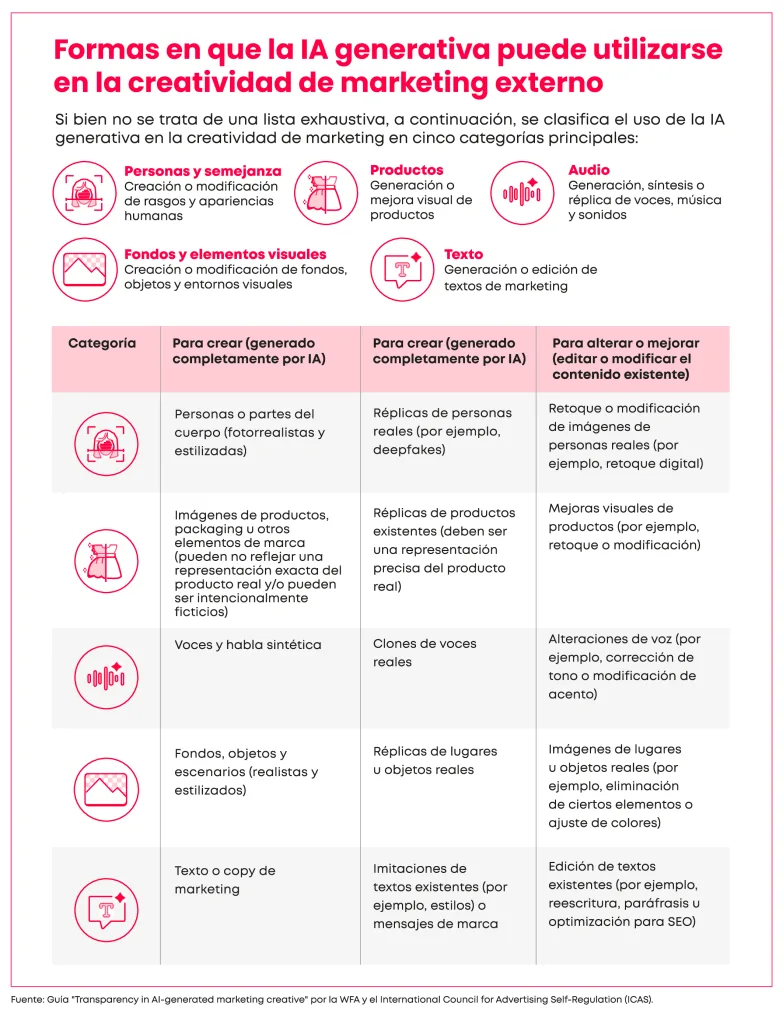

Asimismo, existe un desafío conceptual clave: no todo uso de IA es equivalente. La guía distingue entre contenidos completamente generados, contenidos replicados y contenidos simplemente editados. Cada uno de estos casos implica distintos niveles de intervención y, por lo tanto, debería tener tratamientos diferenciados.

A esto se suma la ausencia de estándares globales. Sin definiciones compartidas, las prácticas pueden variar significativamente entre industrias y mercados, generando inconsistencias que afectan la experiencia del consumidor.

El documento insiste en que la transparencia no puede ser abordada de manera aislada. Antes de definir si un contenido debe ser etiquetado, las marcas deben garantizar que su uso de IA cumple con los principios fundamentales de la publicidad.

Estos principios —legalidad, veracidad, honestidad y no engaño ni ofensa— constituyen la base de la autorregulación publicitaria y siguen siendo plenamente vigentes en el contexto de la inteligencia artificial.

La guía es clara en este punto: declarar que un contenido fue generado por IA no lo hace automáticamente aceptable. Si el contenido es engañoso, seguirá siéndolo independientemente de su etiquetado.

Esto implica que la transparencia debe entenderse como una capa adicional de responsabilidad.

Una vez que las marcas han asegurado que el uso de IA generativa es responsable y respeta la propiedad intelectual, los derechos de autor, los derechos de imagen y otros requisitos legales, deben entonces considerar los siguientes factores al decidir si divulgar su uso:

Para aterrizar estos principios, la guía propone ejemplos concretos en los distintos ámbitos de uso que se hacen de la IA generativa en el marketing:

En el caso de personas y rostros, se sugiere transparentar cuando los personajes generados influyen en la percepción del producto o cuando se replica la imagen de individuos reales, especialmente figuras públicas.

En productos, el eje es la fidelidad. Si la representación generada coincide con la realidad, el etiquetado puede no ser necesario. Pero cuando se trata de versiones conceptuales o inexistentes, la transparencia es clave para evitar expectativas erróneas.

En audio, el foco está en la posibilidad de confusión. Voces sintéticas que podrían interpretarse como humanas deben ser identificadas, especialmente en contextos de interacción.

En entornos visuales, la recomendación depende de si los elementos generados afectan la percepción del producto o su contexto.

En textos, la mayoría de los casos no requiere disclosure, salvo cuando se trata de predicciones o interacciones automatizadas, donde la transparencia resulta relevante para gestionar expectativas.

Un elemento transversal del documento es la necesidad de institucionalizar la gestión de la IA dentro de las organizaciones. La transparencia requiere marcos internos claros, consistentes y actualizables.

Esto incluye definir criterios de uso, establecer protocolos de revisión y monitorear el impacto de las decisiones en la percepción del consumidor.

La guía enfatiza que este es un proceso dinámico. A medida que evolucionan la tecnología, la regulación y las expectativas sociales, las políticas deben adaptarse.

Por último, la guía incorpora un Anexo que identifica los usos de contenido generado y mejorado con IA en la creatividad de marketing que tienen mayor probabilidad de engañar a los consumidores y generar una impresión falsa sobre una marca, un producto o sus usuarios, ayudando a las marcas a reconocer y evitar estas prácticas con ejemplos prácticos.

La inteligencia artificial generativa redefine las reglas del marketing, pero no altera su principio fundamental: la confianza del consumidor es el activo más valioso.

En este contexto, la transparencia emerge como una herramienta clave para sostener esa confianza, pero también como un desafío complejo que requiere equilibrio, criterio y responsabilidad.

La guía de la WFA e ICAS ofrece un marco sólido para navegar la incertidumbre. Su principal aporte es desplazar la conversación desde el cumplimiento hacia la toma de decisiones estratégicas.